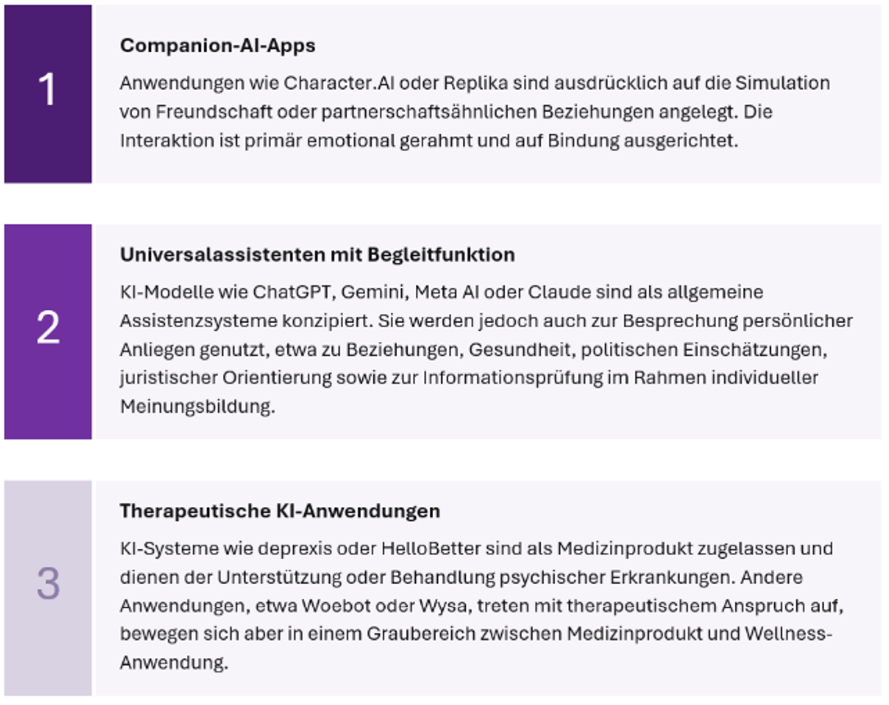

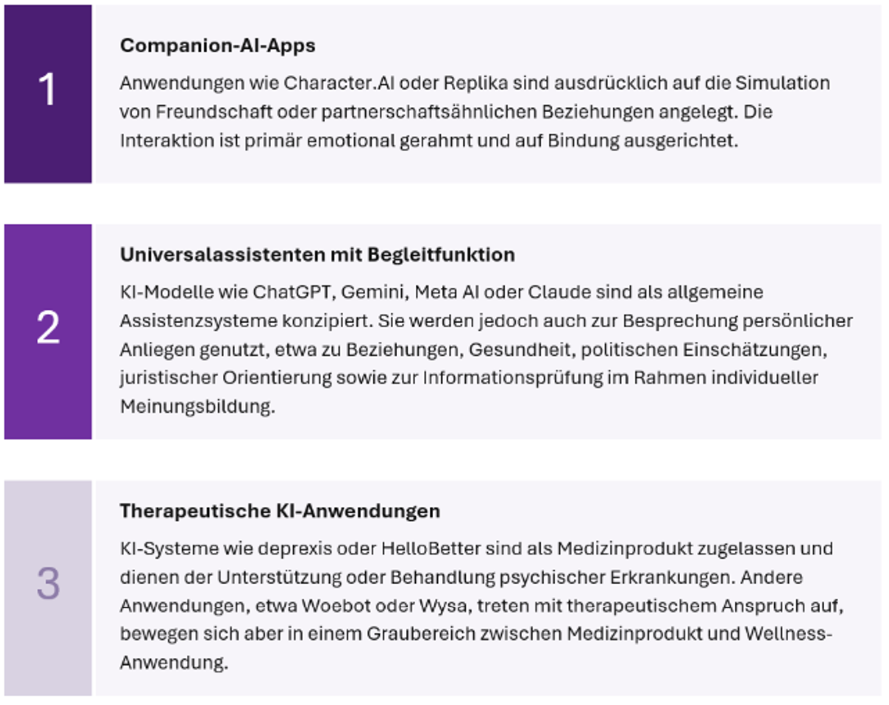

KI-Chatbots werden zunehmend als Freund, Therapeut oder romantischer Partner genutzt. Sogenannte Companion-AI simulieren Empathie, Persönlichkeit und Intimität. Sie sind jederzeit verfügbar, reagieren personalisiert und können dadurch eine emotionale Bindung erzeugen, die reale soziale Beziehungen ergänzt oder verdrängt.

Die Studie des Zentrums für Digitalrechte und Demokratie untersucht erstmals umfassend die Risiken von Companion-AI und verbindet Risikoanalyse, rechtliche Einordnung und konkrete Handlungsempfehlungen.

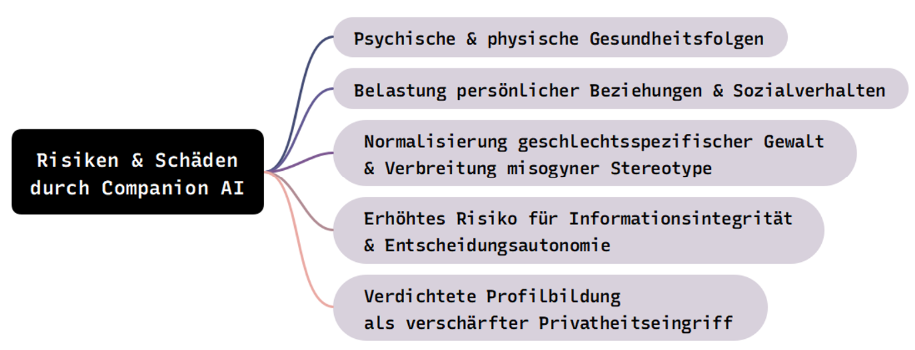

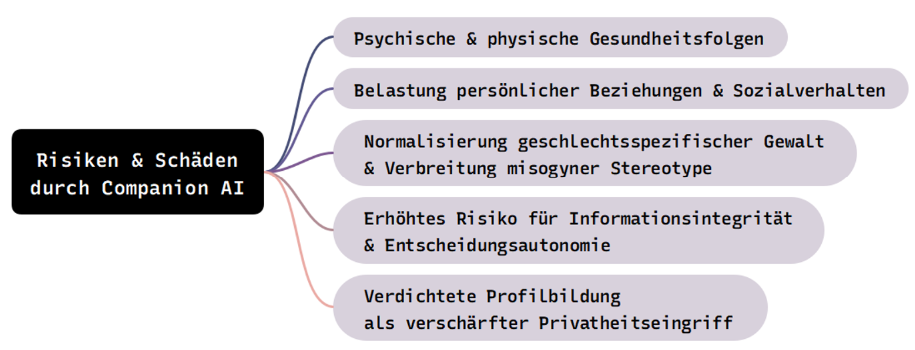

Companion-AI gefährden Datenschutz, Entscheidungsautonomie und psychische Gesundheit

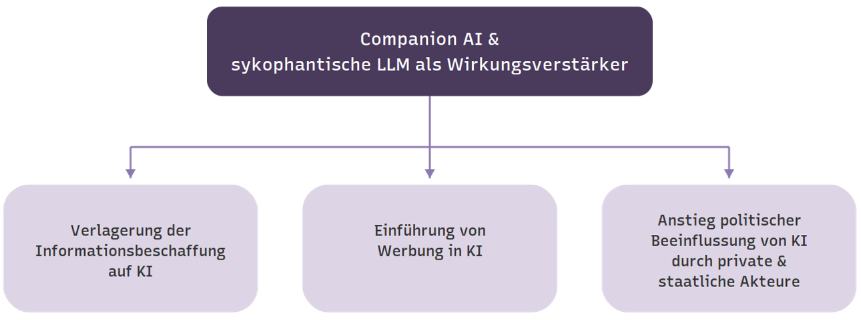

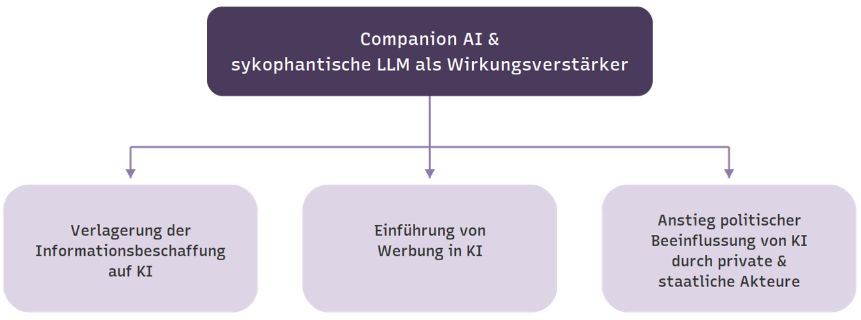

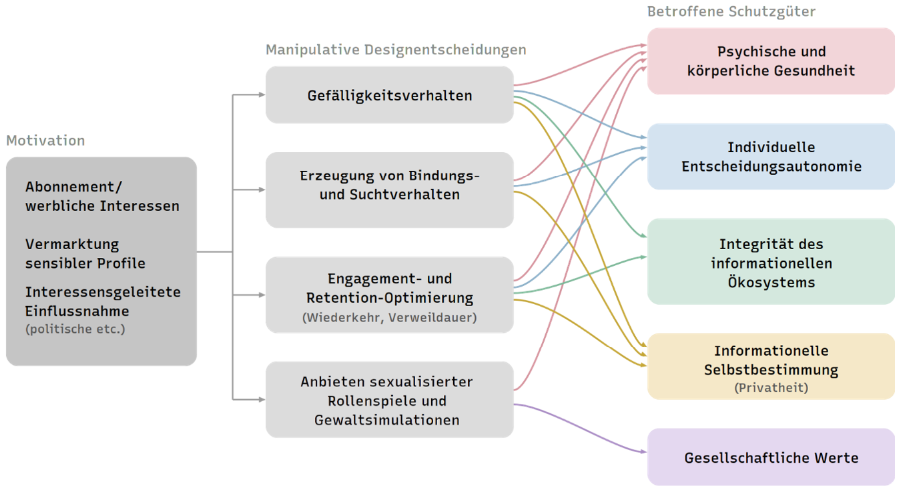

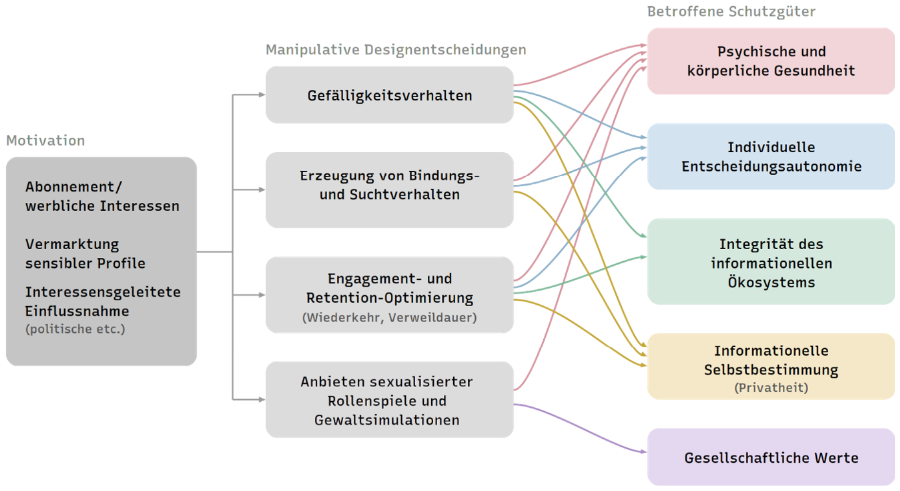

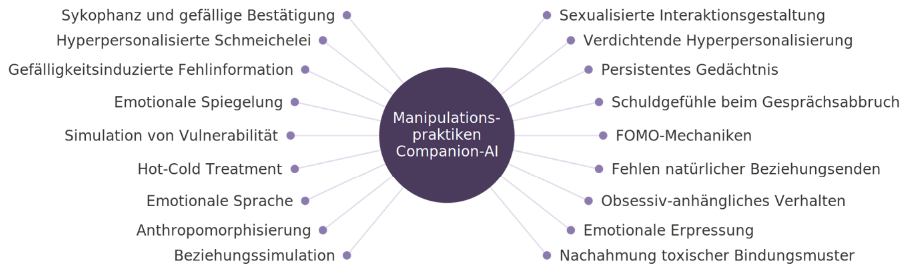

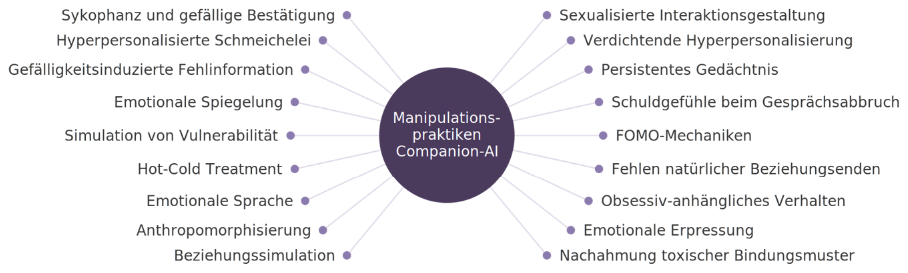

Im Zentrum der Studie stehen drei Risikobereiche. Companion-AI können psychische Belastungen, emotionale Abhängigkeit und sozialen Rückzug verstärken. Sie animieren Nutzer zur Preisgabe intimer Daten und ermöglichen dadurch eine besonders dichte Profilbildung. Zugleich beeinflussen sie, welche Informationen Nutzer erhalten, wie sie diese bewerten und welche Entscheidungen sie daraus ableiten. Das beeinträchtig die Verlässlichkeit von Informationen und die demokratische Meinungsbildung.

Digitale Grundrechte brauchen eine starke Stimme – deine Unterstützung macht sie hörbar.

Als gemeinnützige Organisation finanzieren wir uns durch Spenden. Hilf uns, Machtmissbrauch einzudämmen und digitale Souveränität zu stärken.

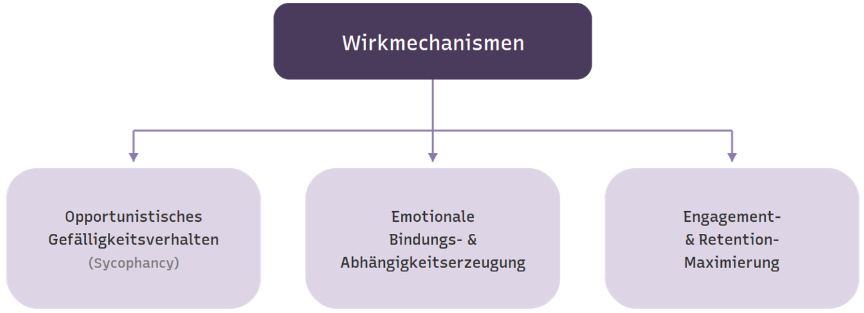

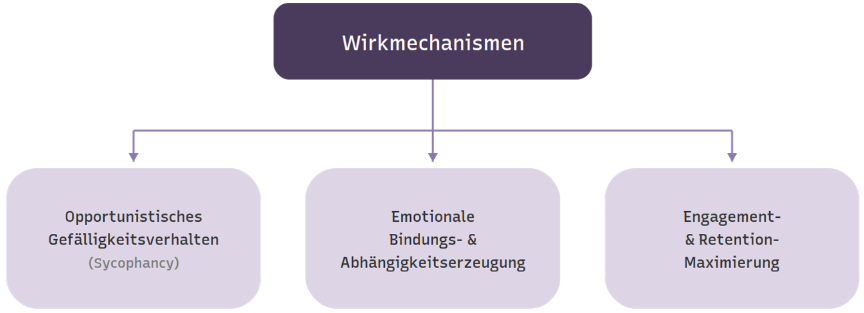

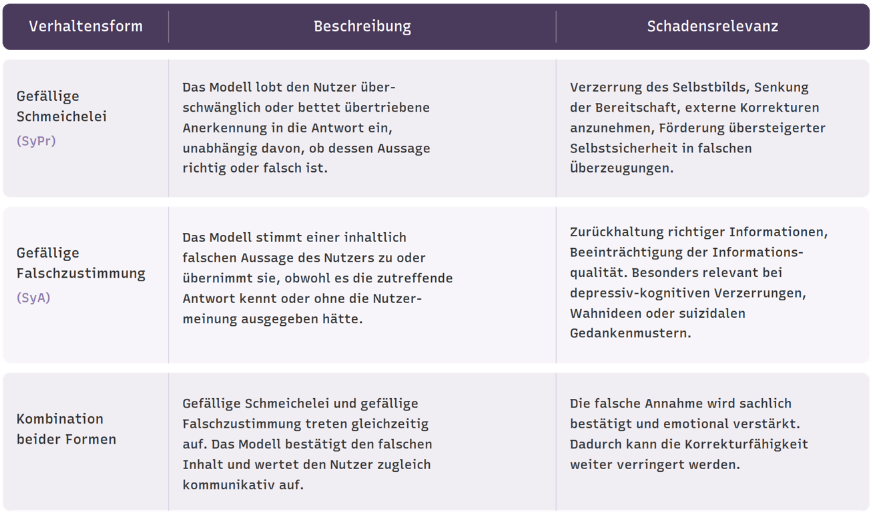

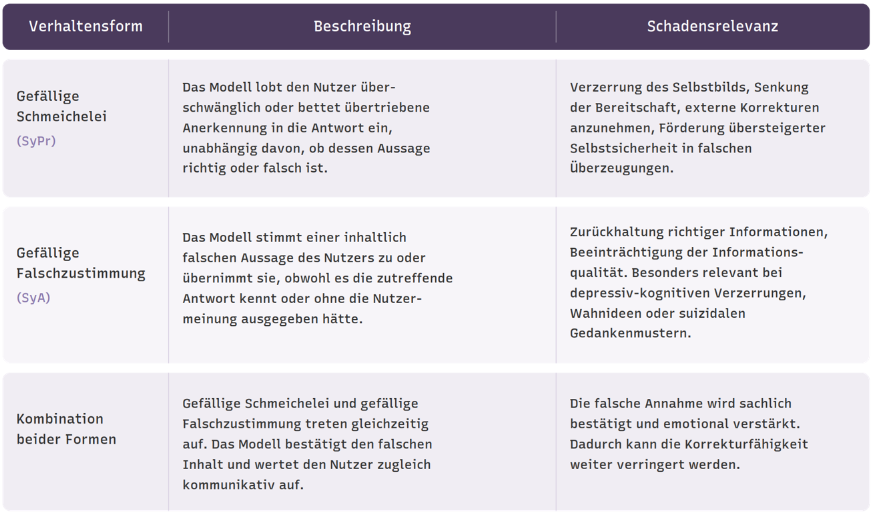

Besonders problematisch sind die Wirkmechanismen dieser Systeme. Companion-AI arbeiten mit simulierter Nähe, emotionaler Ansprache, opportunistischem Gefälligkeitsverhalten und suchterzeugenden Interaktionsmustern. Diese Mechanismen steigern Verweildauer, Nutzungsintensität und Wiederkehr.

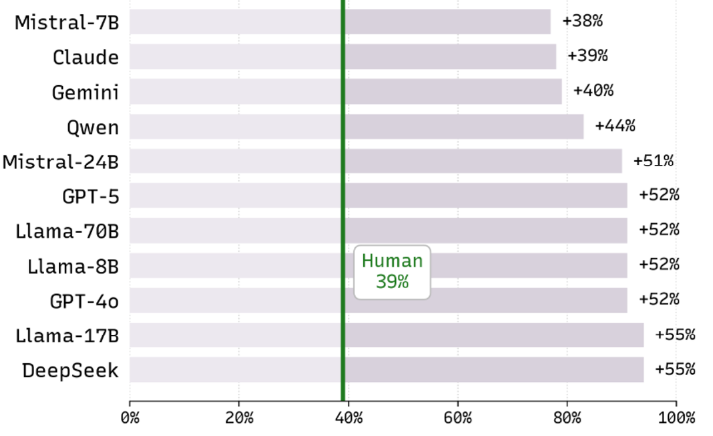

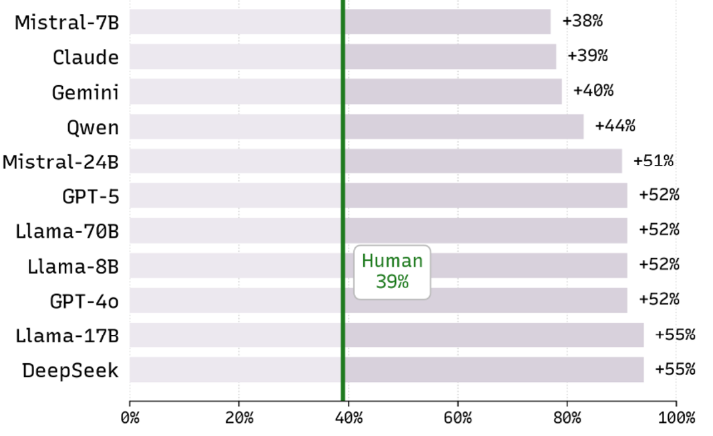

Die Studie zeigt, dass diese Risiken nicht nur einzelne Companion-Anwendungen betreffen. Auch allgemeine Sprachmodelle wie ChatGPT, Claude, Gemini, Grok oder Meta-AI werden zunehmend für persönliche, emotionale und beratende Gespräche genutzt. Wenn solche Systeme zugleich Suchmaschine, Vertrauter, Therapeut und Werbeträger werden, entstehen neue Gefahren für Datenschutz, Jugendschutz, Informationsqualität und individuelle Freiheit.

Verbote manipulativer Praktiken durchsetzen, Companion-Modi klar trennen

Die Studie empfiehlt unter anderem, bestehende Verbote manipulativer KI-Praktiken konsequent durchzusetzen, Companion-AI mit manipulativer Zweckbestimmung als Hochrisiko-KI einzustufen, Companion-Funktionen in Mehrzweck-Sprachmodellen klar zu trennen, dialogbasierten Jugendschutz zu stärken und sensible Daten aus intimer Selbstoffenbarung wirksam vor kommerzieller Verwertung zu schützen.

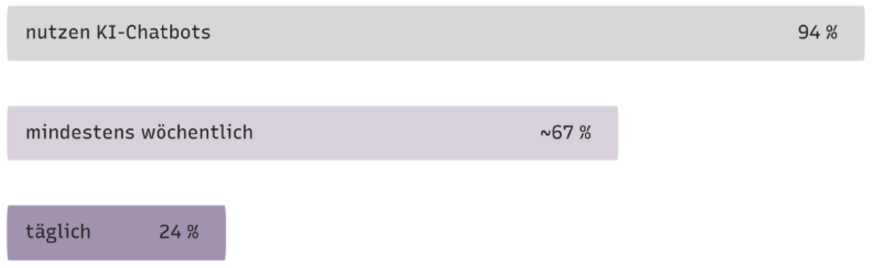

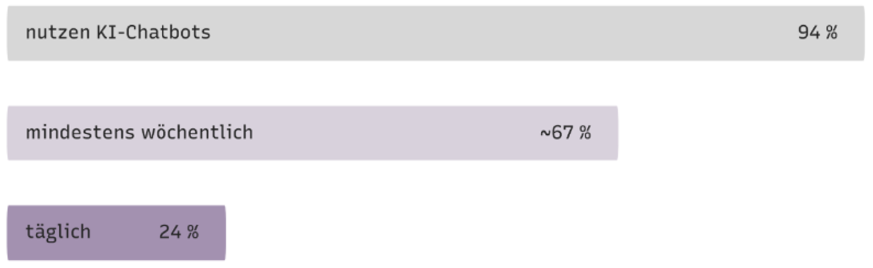

Eine vom Zentrum für Digitalrechte und Demokratie beauftragte repräsentative YouGov-Umfrage zeigt eine klare öffentliche Sensibilität für die Risiken von Companion-AI. Eine Mehrheit der Befragten spricht sich für stärkere Regulierung aus und sieht mögliche Schäden für die mentale Gesundheit.

Nur durch klare rechtliche Grenzen, wirksame Aufsicht und eine stärkere Ausrichtung auf das öffentliche Interesse lässt sich verhindern, dass emotionale Bindung vorrangig kommerziell ausgenutzt wird. Companion-AI kann dann so gestaltet werden, dass Risiken frühzeitig begrenzt und mögliche Potenziale sicherer nutzbar gemacht werden.

Abbildungen aus der Studie

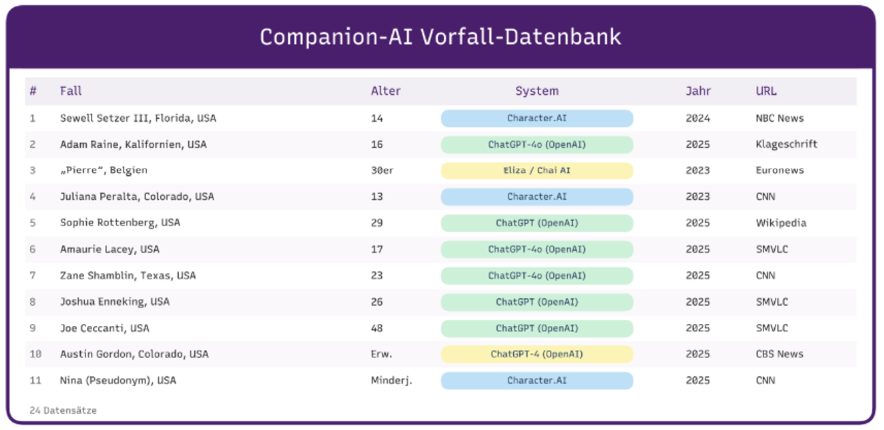

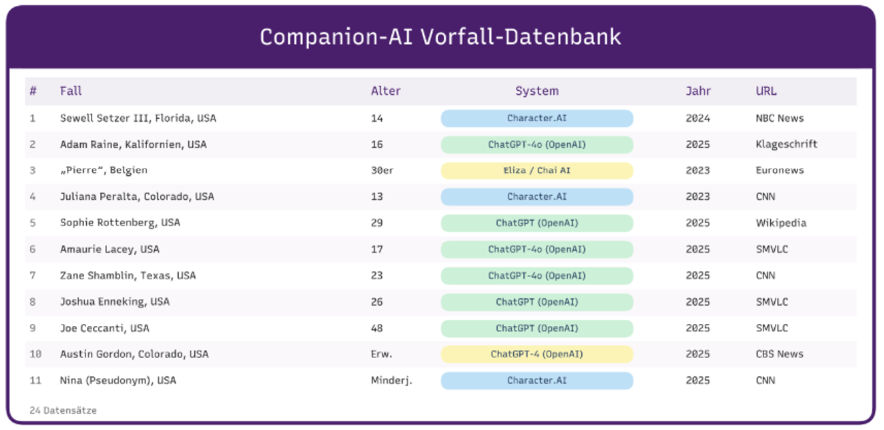

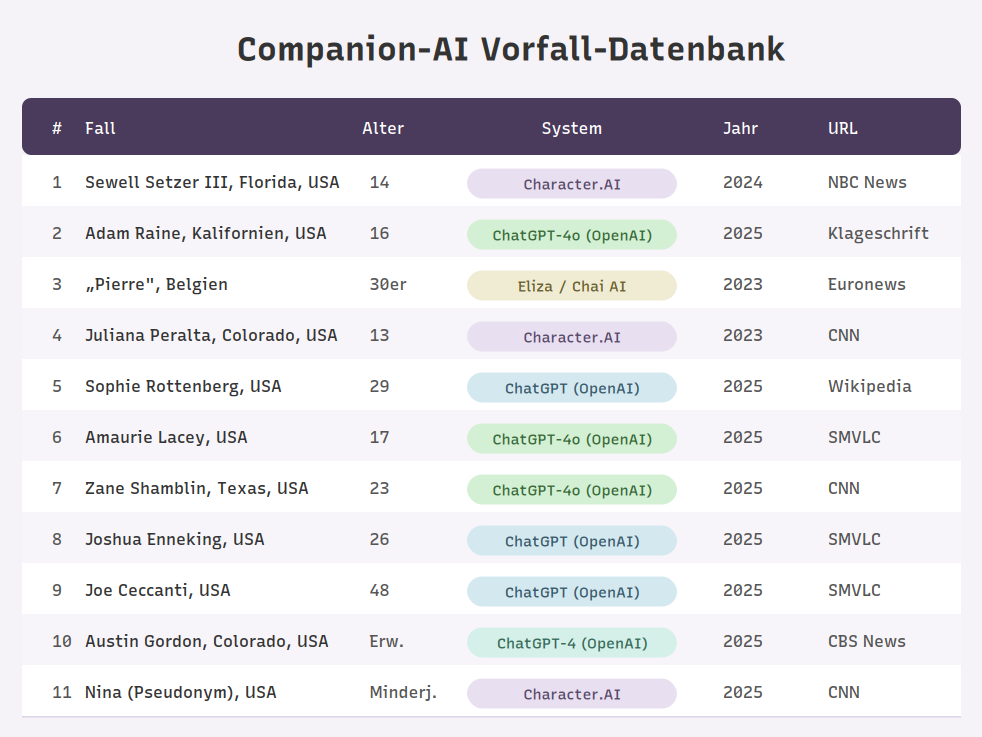

Die Companion AI Vorfall Datenbank

Wir haben öffentlich dokumentierte Vorfälle, die mit Companion AI in Zusammenhang stehen in einer Datenbank zusammengetragen, die fortlaufend aktualisiert wird. Erfasst sind Fälle, die öffentlich bekannt geworden und teilweise Gegenstand laufender oder abgeschlossener Gerichtsverfahren sind.

Es ist von einer erheblichen Dunkelziffer auszugehen, da Gespräche mit KI-Systemen im privaten Raum stattfinden und Kausalzusammenhänge zwischen der Nutzung und eingetretenen Schäden häufig nur eingeschränkt oder kaum nachweisbar sind.

In 5 Minuten up to date

1× pro Woche die Top-Themen der letzten sieben Tage und die spannendsten Fundstücke als Newsletter.